Podjetje Snapchat je v začetku leta 2016 svojo aplikacijo nadgradilo s filtrom face swap za zamenjavo obraza. Uporabnik je lahko z mobilnim telefonom v živo zamenjal svoj obraz z obrazom nekoga drugega. Takrat se je medmrežje šibilo pod težo najrazličnejših humornih izpeljank na ta račun. Omenjena tehnologija seveda ni stagnirala. Snapchat je svoje znanje prepoznavanja obraza izpopolnjeval in do danes omogočil izjemno dobro nadgrajeno resničnost, ki omogoča dodajanje raznih navideznih uhljev, smrčkov in podobnih dopolnil na uporabnikov obraz.

Še ne dolgo tega so morali filmski studii za tovrstne vizualne učinke na velikem platnu zapravljati milijone in najemati izjemno vešče animatorje ter montažerje. Danes pa je osnovna različica te tehnologije spravljena že v žepu vsakega uporabnika pametnega telefona.

In tako se je pred nekaj meseci rodila zvrst videoposnetkov deepfakes. Sprva so se pojavili na portalu reddit, kamor jih je naložil neznani uporabnik »deepfake«, in po njem je ta zvrst tudi prevzela ime. Šlo je za pornografske videe, pri katerih je ustvarjalec na telesa pornoigralcev nameščal obraze svetovnih zvezdnic, kot sta Taylor Swift in Gal Gadot. Zadeva bi najbrž hitro poniknila, če ne bi bili posnetki videti neverjetno pristni in posledično etično sporni. Portali, kot so reddit, twitter in pornhub, takšne videe prepovedujejo in po svojih močeh tudi odstranjujejo.

Seme je zasejano

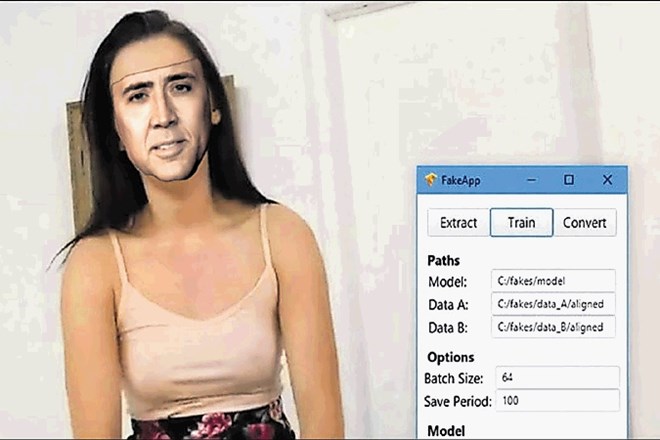

A deepfake seme je bilo zasejano in že v začetku leta se je pojavila računalniška aplikacija fakeapp, ki omogoča na osnovi prosto dostopnih Googlovih podatkov in umetne inteligence enostavno ustvarjanje videovsebin, pri katerih so obrazi akterjev zamenjani z drugimi.

Program deluje kot nekakšna naprednejša različica prej omenjenega snapchata. V program vneseš glavni video, ga povežeš s spletno zbirko fotografij posameznika in po nekaj urah obdelave podatkov dobiš želeni potvorjeni video, ki je pripravljen na deljenje. Boljša in zajetnejša ko je zbirka fotografij posameznika, pristnejša bo videti animacija obraza. Za zdaj se deepfake posnetki pojavljajo predvsem kot sredstvo zabave. Zelo znan je posrečen video, v katerem so na Supermanovo pomočnico Lois Lane dodali obraz igralca Nicolasa Cagea.

Splošna skrb

Glede na dostopnost podatkov lahko program uporabi prav vsakdo. In tu se začenja tudi ena večjih skrbi. Tehnologija hitro napreduje in ni malo verjetno, da se bo začela izrabljati tudi za potegavščine, ki imajo lahko resne posledice na družbo. Recimo temu fake news na steroidih. Eno je, da na spletu beremo novice, ki so morda lažne, ali gledamo s photoshopom prirejene fotografije. Povsem druga dimenzija lažne novice pa je, če gledamo posnetek nekoga kredibilnega, ki govori potvorjene besede. Samo predstavljajte si scenarij z Barackom Obamo, Vladimirjem Putinom ali Donaldom Trumpom v glavni vlogi. Prav tak scenarij so namreč že izvedli pod budnim očesom raziskovalcev univerze Stanford. Razvili so aplikacijo face2face, ki omogoča prenos obrazne mimike posameznika na obraz osebe na videoposnetku. Tehnologijo so predstavili na primeru njihovega raziskovalca, ki nadzoruje vedenje nekdanjega ameriškega predsednika Georgea Busha.

Šokantne novice pa so, kot vemo, olje na ogenj družbenim omrežjem. Kot pojasnjujejo strokovnjaki, je facebook idealno orodje za razširjanje lažnih novic, zato se v tehnološkega velikana polaga velike upe, da bo to področje znal regulirati. A če imajo težave že s pisano besedo, kako se bodo lotili lažnih videov, je glavna skrb strokovnjakov.

Najboljši način, kako se zaščititi pred deepfake posnetki, je enak kot za vse lažne novice – sledite le tistim virom, za katere lahko na dolgi rok prisežete, da so kredibilni.