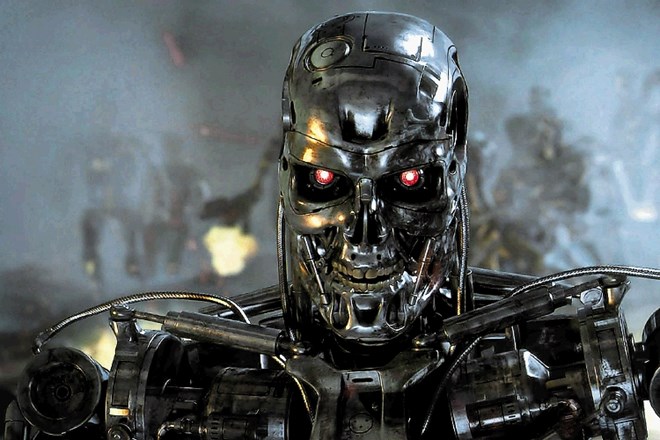

Ko smo si v 80. letih prvič ogledali film Terminator, se je ubijalski robot, opremljen z umetno inteligenco, ki ga je igral Arnold Schwarzenegger, zdel kot popolna znanstvena fantastika ali vsaj kot zelo zelo oddaljena prihodnost. Danes je drugače. Na to je svet opozorilo tudi odprto pismo skoraj 60 znanstvenikov iz približno 30 držav, ki se ukvarjajo z robotiko in umetno inteligenco, v njem pa so druge raziskovalce pozvali k bojkotu južnokorejske državne univerze Korea Advanced Institute of Science and Technology (Kaist). Univerza iz Daejeona naj bi, kot so zapisali v pismu, razvijala umetno inteligenco za vojaško orožje in se s tem pridružila globalni tekmi v razvoju avtonomnega smrtonosnega orožja oziroma ubijalskih robotov.

Znanstveniki so opozorili, da bo, če bodo avtonomno orožje razvili, to povzročilo tretjo svetovno revolucijo v načinu bojevanja, saj bodo omogočili, da bo vojna potekala hitreje in v veliko hujšem obsegu kot kadar koli prej. »Avtonomno orožje ima potencial, da postane orožje terorja. Despoti in teroristi bi ga lahko uporabili proti nedolžnim ljudem, odstranil pa bi vse etične zadržke. To pandorino skrinjico bo težko zapreti, ko se bo enkrat odprla.«

Pakt med univerzo in izdelovalcem orožja

Kaist je konec februarja objavil, da v sodelovanju z družbo Hanwha Systems odpira raziskovalno središče, a so novico s svoje spletne strani pozneje izbrisali. Govorice in skrbi pa so v znanstveni sferi ostale. Hanwha je namreč eden izmed največjih južnokorejskih izdelovalcev orožja, kamor spada tudi kasetno strelivo, ki je prepovedano v 120 državah, ne pa tudi v Južni Koreji, Ameriki, Rusiji in na Kitajskem.

»Z umetno inteligenco lahko narediš ogromno dobrih stvari, ki rešujejo življenja, in to tudi v vojaškem kontekstu, to, da javno razglasiš, da je tvoj cilj razvoj avtonomnega orožja, in da imaš takšnega partnerja, pa vzbuja veliko skrb. Tu je zelo spoštovana univerza sklenila partnerstvo z etično zelo dvomljivim partnerjem, ki kar naprej krši mednarodne norme,« je za medije povedal Toby Walsh, profesor z univerze v Novem Južnem Walesu in pobudnik bojkota. Odgovor predsednika univerze Shin Sung Chula ga je sicer pomiril, a ne popolnoma, tako da od njega želi dodatna pojasnila. Predsednik Kaista je namreč na poziv k bojkotu odgovoril z besedami, da nimajo nobenega namena razviti smrtonosnega avtonomnega orožnega sistema ali ubijalskih robotov, ki delujejo brez človeškega nadzora, saj spoštujejo človekove pravice in etične standarde ter si prizadevajo opravljati raziskave za izboljšanje sveta, kaj več pa ni razlagal.

Kdo bo odgovoren?

Pismo znanstvenikov, med katerimi so tudi podporniki Kampanje za ustavitev ubijalskih robotov (Campaign to stop killer robots), ki se je začela pred petimi leti, je prišlo ravno nekaj dni pred srečanjem v Ženevi 9. aprila, na katerem je 123 članic Združenih narodov razpravljalo o tem, ali naj nadzor nad orožjem ostane v rokah ljudi ali se lahko preda tudi umetni inteligenci. Odločitve za zdaj niso sprejeli, bodo pa »formalno posvetovanje o smrtonosnih avtonomnih sistemih orožja« nadaljevali prihodnje leto.

Dvaindvajset držav poziva k temu, da se avtonomno orožje popolnoma prepove, nekatere pa ga aktivno razvijajo. Med njimi so Amerika, Kitajska, Izrael, Rusija, Velika Britanija in Južna Koreja, ki trenutno uporabljajo oborožene drone in druge avtonomne orožne sisteme z zmanjšanim človeškim nadzorom. Če se bo trend avtonomnosti orožja nadaljeval, pa bo človek iz odločanja nekoč tudi dokončno izločen. Južna Koreja ima na primer že vojsko robotov, ki patruljirajo na meji s Severno Korejo. Gre za Samsungov model robota SGR-A1 z mitraljezom, ki ga trenutno prek videopovezave še vedno upravljajo ljudje, a lahko preklopi tudi na avtonomni način bojevanja. Južnokorejsko podjetje Dodaam Systems izdeluje popolnoma avtonomnega borilnega robota, ki lahko zazna tarčo tudi na treh kilometrih oddaljenosti, med njegovimi kupci so Združeni arabski emirati in Katar, svojega avtonomnega drona pa je naredila tudi britanska družba BAE Systems.

Kot opozarjajo nekatere države, strokovnjaki za umetno inteligenco, Nobelovi nagrajenci ter svetovni in verski voditelji, bi bila to, da strojem dovolimo odločanje o tem, na koga bodo ciljali v vojni, pri nadzoru mej, v izgredih in drugih okoliščinah, usodna napaka. Zmanjšana odgovornost ljudi bi pripeljala tudi do tega, da nikomur ne bo treba odgovarjati za posledice takšnih napadov. To pa je problem, s katerim se bodo v prihodnosti morali soočiti tudi izdelovalci drugih avtonomnih strojev, kot so na primer samovozeči avtomobili, ki so v zadnjem času malo (z)grešili in povzročili smrt ljudi, kriv pa ni nihče.